一键切换稳护航|美创DRCC平台筑牢港口TOS业务连续防线

2026-05-26

从0到1:构建一个AI自动化未授权访问漏洞挖掘 Agent

2026-05-25

预警!数据安全再遇新挑战

2026-05-21

密评 FAQ 第四版新增第 23 问:美创数据库透明加密产品的合规路径解析

2026-05-21

分析|美创DRCC如何开启韧性容灾新篇章,契合“十五五”打造容灾备份体系

2026-05-18

存储域

数据库加密 诺亚防勒索访问域

数据库防水坝 数据库防火墙 数据库安全审计 动态脱敏流动域

静态脱敏 数据水印 API审计 API防控 医疗防统方运维服务

数据库运维服务 中间件运维服务 国产信创改造服务 驻场运维服务 供数服务安全咨询服务

数据出境安全治理服务 数据安全能力评估认证服务 数据安全风险评估服务 数据安全治理咨询服务 数据分类分级咨询服务 个人信息风险评估服务 数据安全检查服务AI智能体正迅速成为企业运营的核心组成部分。无论是处理服务工单、自动化政策执行、定制用户体验,还是管理监管文件,AI智能体已不再局限于实验室或创新沙盒。它们正在积极地影响企业如何提供服务、做出决策以及扩展业务运营。

与传统的机器人或确定性流程的自动化(RPA)系统相比,这些AI智能体在功能和能力上存在显著差异。它们基于大型语言模型(LLMs)、检索增强生成(RAG)以及编排框架构建,具备推理、学习和行动的能力,能够根据上下文进行感知,具有适应性,其行为往往是非确定性的。

最近的一项调查显示,超过90%的企业AI决策者表示已制定了具体计划,打算将生成式AI应用于内部和面向客户的场景。然而,这种热情的出现,却是在监管框架尚不明确、治理模式仍处于追赶阶段的背景下。正如一份Forrester分析师报告所指出的,生成式AI的热潮已将企业推向一个全新的领域,其中潜藏诸多未知风险。

这一变革促使我们重新审视风险、信任与控制的定义。随着这些AI智能体与敏感系统和高风险业务流程日益交互,治理、风险与合规(GRC)职能必须从静态的监管模式,转向嵌入式、实时化的治理机制。

什么是AI智能体?

AI智能体是软件程序,旨在通过感知环境、做出决策并执行行动,自主完成各项任务。与基于规则的机器人不同,AI智能体:

它们可以通过以下方式部署:

企业领域中的实际应用案例包括:

随着AI智能体在功能和自主性方面的不断提升,亟需构建同样具备动态性和情境感知能力的GRC框架,以适配其持续演进与复杂的应用场景。

为何GRC必须关注

与静态系统不同,AI智能体引入了一类全新的风险。它们模糊了数据、逻辑与行动之间的传统界限,具备即兴发挥的能力,这意味着它可以:

当AI智能体在大规模部署时——涵盖数千个应用场景和多个部门——它们会形成一个高度互联、变化迅速的环境,传统治理机制难以跟上其发展速度。

那么结果是什么呢?结果是更容易受到以下风险的影响:

这些风险需要一种新的治理控制措施,能够持续运行,并与智能体的速度和逻辑保持一致。

理解AI智能体的生命周期:4个关键阶段

要建立有效的监管机制,我们首先需要了解智能体在哪些地方以及如何运作。智能体的生命周期包含四个关键阶段:

1. 交互/产生

智能体通过用户提示、消息、系统事件或工作流被激活。它们理解意图,获取上下文并启动操作。

风险:

2. 处理

智能体负责处理输入、检索数据、格式化输出并准备行动链。这一阶段涉及任务协调和工具的使用。

威胁:

3. 决策

智能体执行业务逻辑,借助大型语言模型(LLM)或决策规则生成结果,例如批准退款、提交文件或内容分类。

威胁:

4. 报告/日志记录

输出被存储、展示或转发至仪表盘、文档、工单或用户系统中,这些操作可生成记录,便于审查、学习或审计。

威胁:

GRC必须与这一生命周期保持一致,主动识别、监控和缓解智能体在从意图转向行动过程中的风险。

多智能体环境下的复杂性扩展

原本是一个单智能体的工作流程,很快可能演变为一个多方智能体的生态系统,在这种环境中,任务被分发、记忆被共享,决策逻辑跨越多个模型。例如:

在这些场景中:

近期研究甚至表明,提示感染可能像病毒一样在智能体之间传播,这凸显了构建安全通信层的必要性。

若缺乏明确的智能体范围、数据保留和编排逻辑的政策,风险将不断升级。

GRC必须进化,以管理多智能体生态系统,其中治理不能止步于单个智能体的边界。

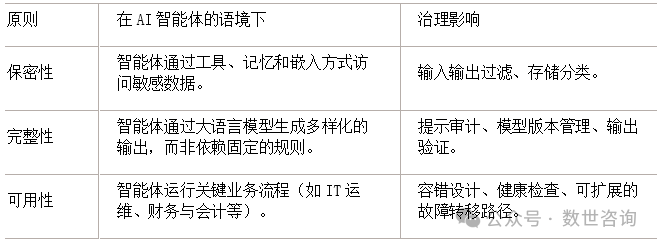

重新构想CIA三元组以适应智能体工作流

传统的CIA三元组——机密性、完整性和可用性——需要重新解读:

我们必须为 AI 治理增添三个新的支柱,以确保其未来可持续发展。

重新定义诸如机密性、完整性、可用性等基础原则,凸显了为自主系统量身打造的GRC模型的必要性。

人类在治理智能体中的作用

随着自主系统能力的不断提升,它们也变得越来越难以预测。这进一步凸显了前线运营的GRC专业人员的重要性,他们能够:

这些人员并非传统的合规监督者,而是具备适应性、战略思维和熟悉AI技术的复合型人才。他们能够在AI高度应用的环境中,结合专业背景、伦理判断、前瞻性视野和治理设计,发挥关键作用。

在以智能体主导的环境中建立有效的安全与合规态势,需要在部署技术控制措施的同时,培养这种新型的人类能力。这种以人为中心的方法强调,有效的GRC(治理、风险与合规)不仅关乎技术控制,更涉及组织架构的设计。

与全球监管框架保持一致

随着以智能体驱动的工作流程触及受监管领域,隐私和合规性问题变得尤为重要。当前的监管环境正快速演变:

监管风险在以下情况下会加剧:

为满足合规要求,GRC团队必须将合规覆盖范围扩展至包括:

新兴法规验证了企业将细粒度、可追溯的GRC能力嵌入智能体工作流程的紧迫性。

GRC团队应重点关注的领域。

为实现大规模可信AI,GRC组织必须主动将治理嵌入五大支柱之中。

1. 身份与访问

2. 提示与输出管理

3. 内存与上下文控制

4. 可解释性基础设施

5. 监控与漂移管理

具有前瞻性的组织正在将这些控制措施与“AI 紧急停止开关”、模型卡片声明以及甚至 AI 风险保险相结合。

每个重点领域都使GRC负责人能够强化智能体操作,同时实现规模扩展和敏捷性。

从控制到信任

AI智能体代表了一种范式转变。它们已经到来,并且将长期存在,其价值显而易见。然而,相关风险也同样不容忽视。未来的发展方向不在于减缓采用速度,而在于构建合适的治理能力,以跟上技术发展的步伐。

为实现大规模负责任的自主性,组织必须:

AI智能体不会等待政策的跟进,我们的任务是确保政策能够跟上智能体的发展方向。

在治理方面领先的企业将获得:

安全、风险与合规团队如今有机会——也肩负着责任——为企业下一代自动化架构构建信任。